机器学习 回归算法,二、回归算法的基本概念

机器学习中的回归算法是一种用于猜测接连数值的猜测办法。它经过树立输入特征和输出方针之间的数学联系,来猜测不知道数据点的数值。回归算法广泛使用于各种范畴,如金融猜测、房价猜测、销量猜测等。

回归算法的首要方针是找到一个函数,该函数能够最小化猜测值与实践值之间的差异。这个函数一般是一个线性函数,但在某些情况下,或许需求运用非线性函数来更好地拟合数据。

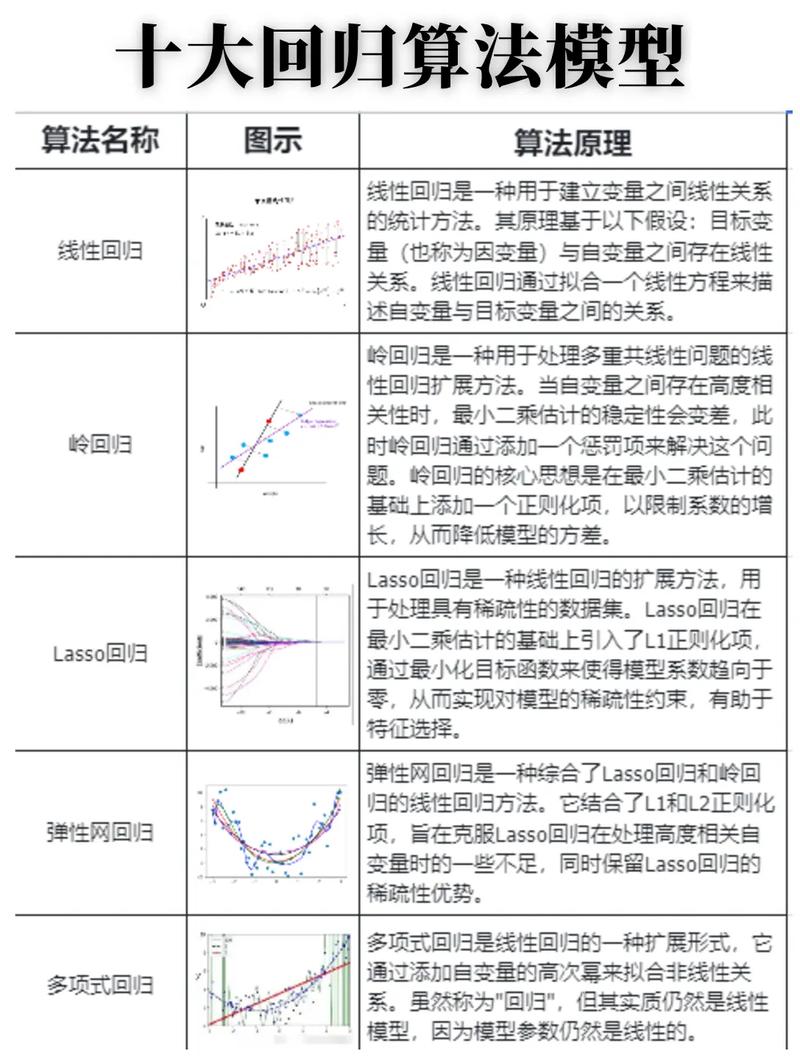

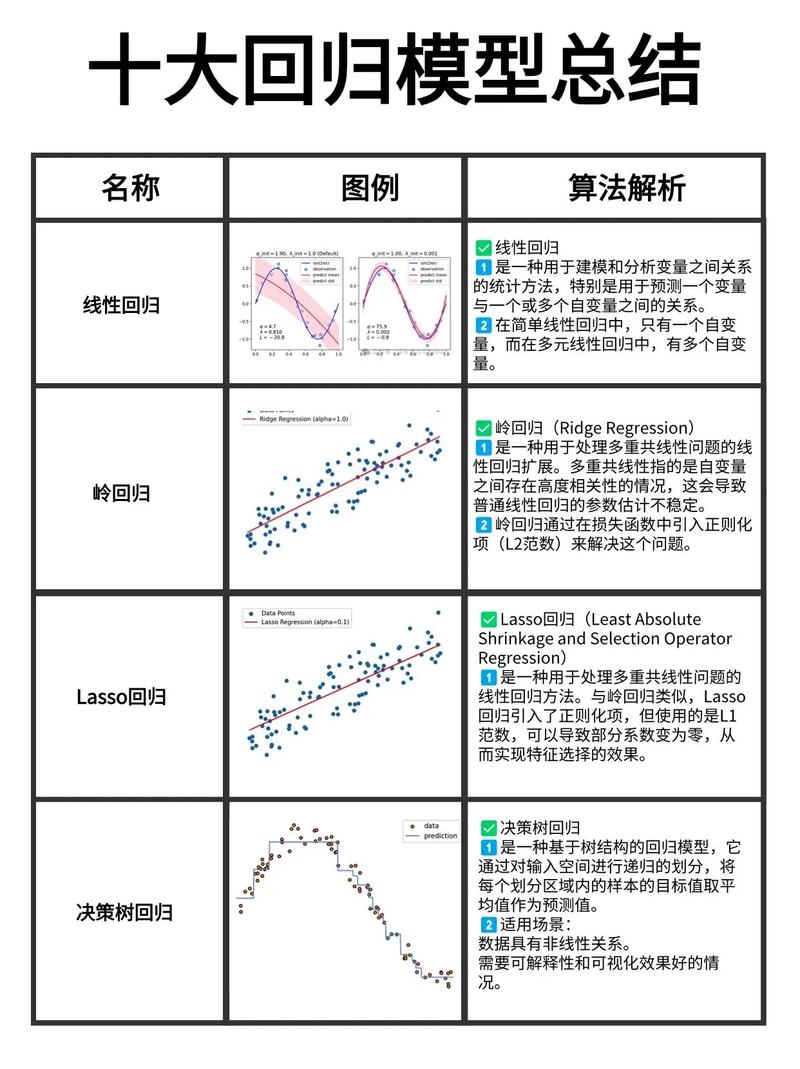

以下是几种常见的回归算法:

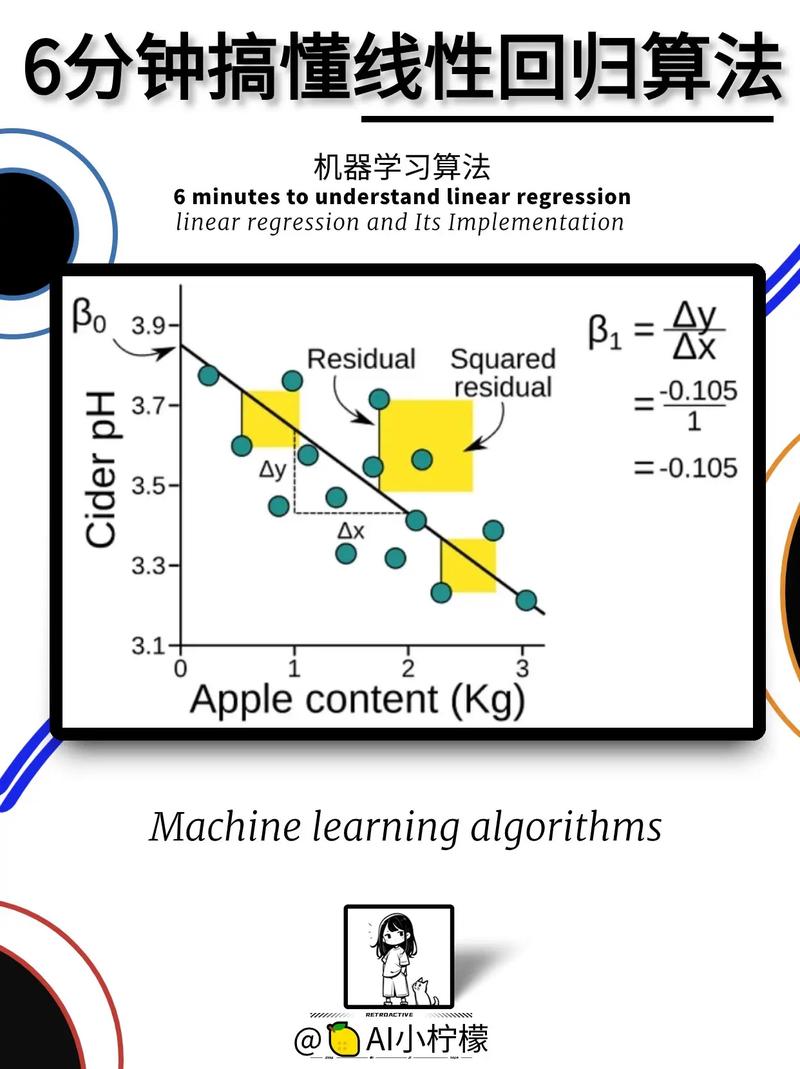

1. 线性回归(Linear Regression):线性回归是最基本的回归算法,它假定输入特征和输出方针之间存在线性联系。线性回归的方针是找到一个线性方程,使得猜测值与实践值之间的差异最小。

2. 决策树回归(Decision Tree Regression):决策树回归是一种依据决策树的回归算法。它经过递归地切割数据集,将数据集划分为更小的子集,并在每个子集上树立回归模型。决策树回归能够处理非线性联系,而且具有很好的解说性。

3. 随机森林回归(Random Forest Regression):随机森林回归是一种依据决策树的集成学习算法。它经过构建多个决策树,并将它们的猜测成果进行均匀,来进步猜测的准确性。随机森林回归能够处理非线性联系,而且对噪声数据具有较好的鲁棒性。

4. 支撑向量回归(Support Vector Regression):支撑向量回归是一种依据支撑向量机的回归算法。它经过找到一个超平面,使得猜测值与实践值之间的差异最小。支撑向量回归能够处理非线性联系,而且具有很好的泛化才能。

5. 神经网络回归(Neural Network Regression):神经网络回归是一种依据神经网络的回归算法。它经过构建一个多层神经网络,将输入特征映射到输出方针。神经网络回归能够处理杂乱的非线性联系,而且具有很好的泛化才能。

这些回归算法各有优缺陷,挑选适宜的回归算法需求依据具体问题和数据的特点来决议。在实践使用中,一般需求经过穿插验证等办法来评价不同回归算法的功能,并挑选功能最好的算法进行猜测。

深化解析机器学习中的回归算法

在机器学习范畴,回归算法是一种重要的猜测建模技能。它经过树立因变量与自变量之间的数学联系,协助咱们猜测和剖析数据。本文将深化解析机器学习中的回归算法,包含其基本概念、常用算法、优缺陷以及实践使用。

二、回归算法的基本概念

回归算法旨在经过剖析历史数据,树立因变量与自变量之间的数学模型,然后对不知道数据进行猜测。在回归问题中,因变量一般是接连的,而自变量可所以接连的或离散的。

三、常用回归算法

1. 线性回归

线性回归是最基本的回归算法,它假定因变量与自变量之间存在线性联系。线性回归模型能够表明为:y = β0 β1x1 β2x2 ... βnxn ε,其间y为因变量,x1, x2, ..., xn为自变量,β0, β1, ..., βn为模型参数,ε为差错项。

2. 逻辑回归

逻辑回归是一种特别的线性回归,用于处理二分类问题。它经过Sigmoid函数将线性回归的输出映射到(0, 1)区间,然后得到一个概率值,表明样本归于某一类的或许性。

3. 多元线性回归

多元线性回归是线性回归的扩展,它考虑多个自变量对因变量的影响。多元线性回归模型能够表明为:y = β0 β1x1 β2x2 ... βnxn ε,其间y为因变量,x1, x2, ..., xn为自变量,β0, β1, ..., βn为模型参数,ε为差错项。

4. 逐渐回归

逐渐回归是一种依据模型挑选原则的回归算法,它经过逐渐挑选最优的自变量,树立回归模型。逐渐回归能够有效地处理高维数据,进步模型的猜测精度。

四、回归算法的优缺陷

1. 长处

(1)易于了解和完成;

(2)适用于多种数据类型;

(3)能够处理高维数据;

(4)模型参数易于解说。

2. 缺陷

(1)对异常值灵敏;

(2)假定因变量与自变量之间存在线性联系,或许不适用于非线性问题;

(3)模型参数较多,或许存在过拟合现象。

五、回归算法的实践使用

回归算法在各个范畴都有广泛的使用,以下罗列一些常见的使用场景:

(1)金融范畴:股票价格猜测、信誉评分、危险评价等;

(2)医疗范畴:疾病猜测、药物效果评价、患者预后等;

(3)工业范畴:产品质量猜测、设备毛病猜测、生产过程优化等。

回归算法是机器学习范畴的重要东西,它能够协助咱们树立因变量与自变量之间的数学模型,然后对不知道数据进行猜测。本文对回归算法的基本概念、常用算法、优缺陷以及实践使用进行了深化解析,期望对读者有所协助。

相关

-

斑马ai图形归纳推理,立异教育助力未来思想开展详细阅读

斑马AI课是由猿教导在线教育出品,专为28岁孩子规划的思想与言语学习课程。以下是关于斑马AI课图形归纳推理的具体信息:课程体系斑马AI课的课程体系分为5个等级,分别是S1、S...

2024-12-23 0

-

ai综合征,人工智能在医疗范畴的使用与应战详细阅读

1.界说与体现:AI综合征不仅仅是“写作不想打字”的直观改动,更是内心深处对智能辅佐的深化依靠与神往。2.事例:一个名叫塞维尔·塞泽尔三世的14岁男孩,因沉...

2024-12-23 0

-

吴恩达机器学习,敞开人工智能学习之旅详细阅读

吴恩达(AndrewNg)是斯坦福大学计算机科学系和电气工程系的客座教授,也是Coursera的联合创始人之一。他在机器学习和深度学习范畴有深沉的研讨和教育经历。以下是关于吴...

2024-12-23 0

-

ai教育归纳素质,AI赋能教育,进步学生归纳素质详细阅读

AI教育归纳素质是指一个人在AI教育范畴所需具有的多方面才能,包含但不限于技术才能、批判性思想、立异才能和品德素质等。以下是对AI教育归纳素质的具体解说:1.技术才能:AI教...

2024-12-23 0

-

机器学习十大,揭秘人工智能的核心技能详细阅读

1.线性回归:线性回归是一种根底的监督学习算法,用于猜测数值型方针变量。它假定输入特征与方针变量之间存在线性联系。2.决策树:决策树是一种非参数的监督学习算法,经过一系列规...

2024-12-23 0

-

机器学习视觉,技能概述与未来展望详细阅读

机器学习视觉(MachineLearningVision)是指使用机器学习技能来处理和剖析视觉数据,如图画和视频。它触及多个范畴,包含核算机视觉、深度学习、模式辨认和机器学...

2024-12-23 1

-

ai技能是什么技能,什么是AI技能?详细阅读

什么是AI技能?AI技能,即人工智能技能,是指经过模仿、延伸和扩展人的智能,使核算机具有学习、推理、了解、感知、认知和决议计划等才能的一系列技能。它涵盖了核算机科学、认知科学、...

2024-12-23 1

-

机器学习分类图片,技能概述详细阅读

1.卷积神经网络(CNN):这是最常用的图画分类办法之一。CNN是一种深度学习算法,它能够主动学习图画中的特征,并经过这些特征来对图画进行分类。CNN在许多图画分类使命中体现...

2024-12-23 1

-

ai智能机器人外呼体系,企业服务转型的得力助手详细阅读

AI智能机器人外呼体系是一种运用人工智能技能完结主动拨打电话、进行语音交互的体系。它可以模仿人类的语音和对话,与客户进行天然、流通的交流。以下是AI智能机器人外呼体系的一些主要...

2024-12-23 1

-

js 机器学习,敞开前端智能年代详细阅读

1.TensorFlow.js:这是一个由Google开发的开源库,答应开发者运用JavaScript进行机器学习模型的练习和布置。它供给了丰厚的API,支撑各种机...

2024-12-23 0